Las API heredadas a menudo luchan por mantenerse al día con las demandas modernas, lo que genera tiempos de respuesta lentos, usuarios frustrados y costos aumentados. ¿La buena noticia? No necesitas una revisión completa para mejorar el rendimiento. Así es como puedes abordar los problemas más comunes:

Para equipos que buscan modernizarse sin recursos de codificación extensos, plataformas como Adalo, un constructor de aplicaciones sin código para aplicaciones web basadas en bases de datos y aplicaciones nativas de iOS y Android—una versión en las tres plataformas, publicada en la App Store de Apple y Google Play, ofrecen una alternativa práctica. Estas herramientas te permiten construir aplicaciones modernas conectadas a API mientras eliminas gradualmente sistemas heredados.

- Arquitectura Obsoleta: Los sistemas monolíticos y protocolos más antiguos como HTTP/1.1 crean cuellos de botella. El cambio a microservicios o la actualización a HTTP/2/3 puede mejorar la eficiencia.

- Recuperación de Datos Ineficiente: Las consultas sin indexar, las llamadas redundantes y los problemas N+1 ralentizan las cosas. Optimizar consultas, agregar índices y usar agrupamiento de conexiones puede acelerar las operaciones.

- Falta de Almacenamiento en Caché: Sin almacenamiento en caché, las API heredadas procesan repetidamente las mismas solicitudes. La implementación del almacenamiento en caché de borde, a nivel de aplicación y del lado del cliente puede reducir los tiempos de respuesta hasta un 90%.

Ganancias Rápidas:

- Agregar capas de almacenamiento en caché (p. ej., Redis, Cloudflare).

- Optimizar consultas de base de datos (p. ej., indexación, paginación).

- Usar envolturas de API para funcionalidad moderna sin reconstruir.

Soluciones a Largo Plazo:

- Cambiar gradualmente a microservicios utilizando métodos como el Patrón Strangler Fig.

- Monitorear el rendimiento con herramientas como Prometheus o Datadog.

- Incorporar IA para conocimientos en tiempo real y escalado predictivo.

Incluso mejoras menores, como almacenamiento en caché u optimización de consultas, pueden reducir significativamente la latencia y mejorar la experiencia del usuario. Comienza pequeño, mide el impacto y construye hacia un sistema más moderno y eficiente.

7 Mejores Formas de Multiplicar tu Rendimiento de API por 10

Problemas de Rendimiento Comunes en API Heredadas

Para abordar los problemas de rendimiento en las API heredadas, primero debes identificar qué está causando la desaceleración. La mayoría de los problemas se dividen en tres categorías: diseños de sistemas obsoletos, recuperación de datos ineficiente y la ausencia de mecanismos de almacenamiento en caché. Examinemos cada uno.

Arquitectura y Protocolos Antiguos

Las API heredadas a menudo se basan en arquitecturas monolíticas, donde todas las funciones están fuertemente agrupadas en una aplicación. Esta configuración hace que el escalado sea ineficiente: si un componente necesita más recursos, todo el sistema debe escalar, lo que aumenta los cuellos de botella de tráfico y centraliza la carga del sistema.

Los protocolos utilizados por sistemas más antiguos agravran la ineficiencia. Las API construidas en SOAP o versiones REST antiguas a menudo sufren de sobrecarga, devolviendo objetos de datos grandes e innecesarios que desperdician ancho de banda. Estos sistemas a menudo carecen de conexiones persistentes, requiriendo un protocolo de enlace TCP (y SSL/TLS) nuevo para cada solicitud. Muchos aún usan HTTP/1.1, que procesa solicitudes secuencialmente y no admite multiplexación como HTTP/2 o HTTP/3. Este modelo sincrónico ralentiza aún más las operaciones.

¿Un ejemplo del mundo real? NetflixLa transición de una estructura monolítica a microservicios con computación perimetral resultó en una mejora del 70% en el rendimiento de la API. Esto destaca cómo modernizar la arquitectura puede tener un impacto dramático en los tiempos de respuesta y la experiencia del usuario.

Métodos Pobres de Recuperación de Datos

La forma en que las API heredadas manejan la recuperación de datos es otro cuello de botella común. Las consultas de base de datos sin indexar obligan al sistema a escanear tablas completas, lo que ralentiza significativamente el procesamiento. Peor aún, las prácticas de codificación ineficientes como el problema de consultas N+1—donde se realizan múltiples llamadas a bases de datos en lugar de obtener datos relacionados en una sola consulta—agregan retrasos innecesarios. Esto es especialmente problemático para usuarios móviles con conexiones más lentas.

Otras ineficiencias incluyen llamadas de datos redundantes, donde se solicita la misma información múltiples veces durante una transacción única, o usar bucles anidados que amplifican retrasos a medida que los datos se escalan. Los sistemas que frecuentemente abren y cierran conexiones de base de datos en lugar de usar un grupo de conexiones también experimentan mayor latencia. Las herramientas de monitoreo como Tiempo hasta el Primer Byte (TTFB) o ejecutar el comando SQL EXPLAIN pueden ayudar a identificar cuellos de botella como índices faltantes.

Sistemas de Almacenamiento en Caché Faltantes

La ausencia de almacenamiento en caché es otro asesino del rendimiento. Sin almacenamiento en caché, las API heredadas regeneran las mismas respuestas y repiten consultas de bases de datos idénticas para cada solicitud. Esto no solo aumenta la latencia sino que también ejerce presión constante en los sistemas backend, especialmente durante picos de tráfico.

La falta de almacenamiento en caché de borde agrega más retrasos, ya que los datos deben viajar desde el servidor central al usuario en cada solicitud. Los sistemas heredados también dependen mucho del sondeo en lugar de patrones impulsados por eventos, lo cual es muy ineficiente: los datos nuevos solo se recuperan el 1,5% del tiempo durante el sondeo.

Implementar almacenamiento en caché, aunque desafiante en sistemas antiguos, puede mejorar dramáticamente el rendimiento. Sin embargo, requiere una lógica de invalidación bien diseñada, como purga desencadenada por eventos o valores precisos de Tiempo de Vida, para garantizar que los datos se mantengan frescos. Cuando se realiza correctamente, el almacenamiento en caché puede reducir los tiempos de respuesta de la API del 70% al 90% para respuestas almacenadas en caché, lo que lo convierte en una de las formas más efectivas de modernizar el rendimiento.

Cómo mejorar el rendimiento de la API heredada

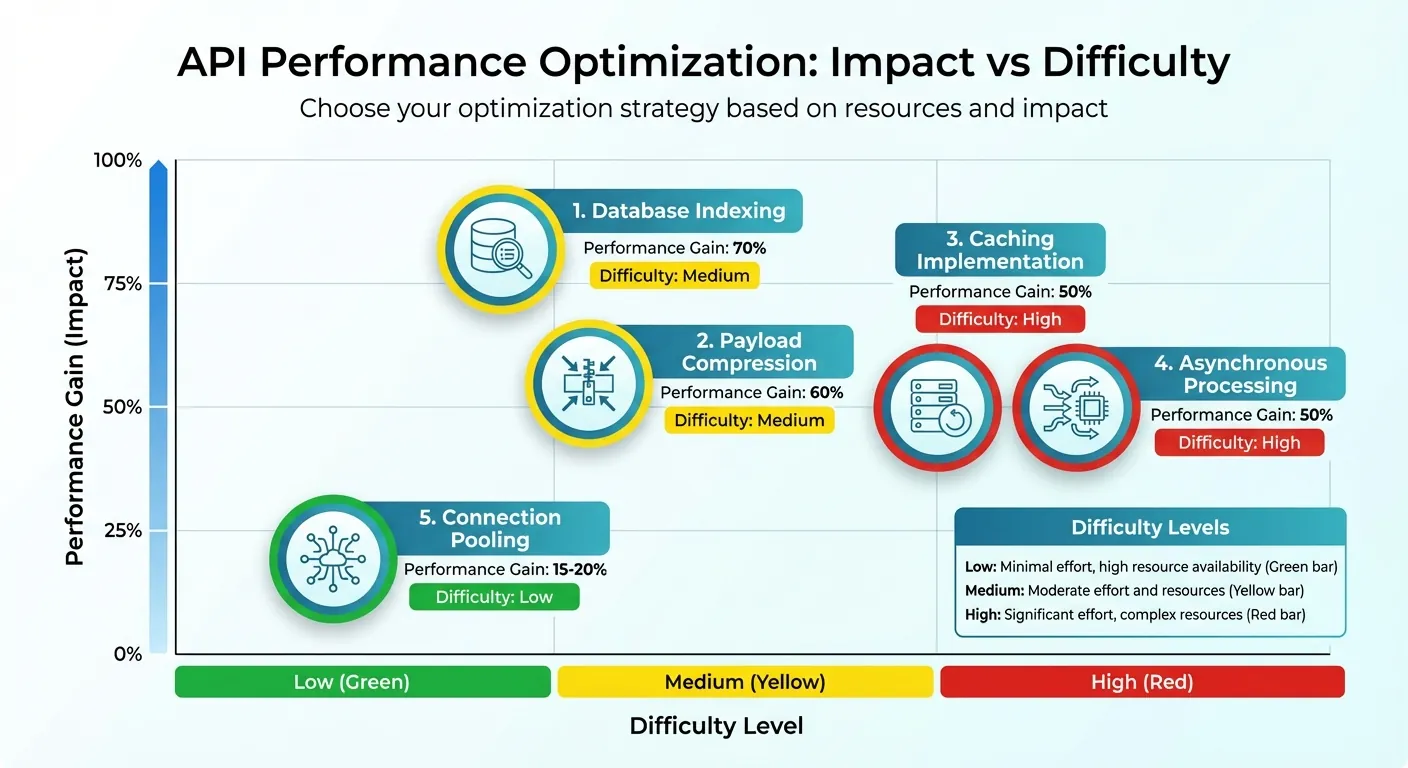

Técnicas de optimización del rendimiento de la API: comparación de impacto versus dificultad

Mejorar el rendimiento de las API heredadas a menudo se reduce a estrategias inteligentes como agregar capas de almacenamiento en caché, refinar consultas de base de datos y usar envoltorios de API. Aquí hay un análisis más detallado de cómo estos métodos pueden marcar la diferencia.

Agregar capas de almacenamiento en caché

El almacenamiento en caché es un factor decisivo cuando se trata de acelerar las respuestas de la API. Al almacenar temporalmente datos a los que se accede frecuentemente, puede evitar golpes repetidos en la base de datos o regenerar el mismo resultado. Una estrategia de almacenamiento en caché de múltiples niveles funciona mejor, abordando diferentes partes del sistema.

- Almacenamiento en caché de borde: Servicios como Cloudflare o Akamai almacenan datos más cerca de los usuarios finales, reduciendo drásticamente los tiempos de espera, de cientos de milisegundos a solo unos pocos.

- Almacenamiento en caché a nivel de aplicación: Herramientas como Redis Memcached manejan el almacenamiento en caché del lado del servidor para consultas de base de datos pesadas o datos calculados.

- Almacenamiento en caché del lado del cliente: Esto almacena datos invariables directamente en el dispositivo o navegador del usuario.

También puede implementar almacenamiento en caché a nivel de puerta de enlace de API para garantizar políticas consistentes en todos los puntos finales. Para un almacenamiento en caché efectivo, concéntrese en tres factores clave:

- TTL (Tiempo de Vida): Establezca duraciones apropiadas según la frecuencia con que cambien los datos.

- Claves de caché: Use encabezados o parámetros de URL para identificar solicitudes de forma única.

- Estrategias de invalidación: Actualice datos almacenados en caché obsoletos durante horas valle.

"Si hay un superhéroe de reducción de latencia, definitivamente es el almacenamiento en caché. ¡Nada supera evitar una solicitud completamente!" - Zuplo

Los resultados hablan por sí solos. Por ejemplo, Xata redujo la latencia de la API en un 50% combinando computación de borde y almacenamiento en caché a través de la CDN de Cloudflare. Para maximizar los beneficios, supervise el tráfico en busca de solicitudes repetitivas y ajuste la configuración de TTL para equilibrar la actualización y la velocidad.

Corrigiendo consultas de base de datos

A menudo, las consultas de base de datos lentas son el principal culpable detrás de las API lentas. Optimizar estas consultas puede mejorar significativamente los tiempos de respuesta con cambios mínimos de infraestructura.

- Indexación: Aplique índices a columnas consultadas frecuentemente, especialmente aquellas utilizadas en cláusulas WHERE, JOINs u ORDER BY. Esto puede reducir el tiempo de ejecución de consultas hasta un 90%.

- Recuperación selectiva de datos: Evite usar

SELECT *. En su lugar, recupere solo las columnas que necesita, reduciendo la carga de procesamiento y red. - Reescritura de consultas: Simplifique las consultas reemplazando subconsultas con JOINs o tablas temporales. Use

EXISTSen lugar deINpara mejor rendimiento en verificaciones condicionales, y filtre datos con cláusulasWHEREen lugar deHAVING, ya que la primera se procesa antes. - Agrupación de conexiones: Las conexiones de base de datos preestablecidas ahorran tiempo al eliminar la sobrecarga de abrir y cerrar conexiones en cada solicitud. Esto puede mejorar el rendimiento del sistema del 15% al 20%.

- Paginación: Divida grandes conjuntos de datos en fragmentos más pequeños usando

LIMITyOFFSETo métodos basados en cursores. Establezca tamaños de página predeterminados (10–50 elementos) y límites para evitar que solicitudes pesadas sobrecarguen el sistema.

| Técnica de optimización | Ganancia potencial de rendimiento | Nivel de dificultad |

|---|---|---|

| Indexación de base de datos | 70% | Medio |

| Compresión de Carga | 60% | Medio |

| Implementación de Caché | 50% | Alto |

| Procesamiento Asincrónico | 50% | Alto |

| Agrupación de Conexiones | 15–20% | Baja |

Uso de Envolvedores de API

Los envolvedores de API ofrecen una forma práctica de modernizar sistemas heredados sin una revisión completa. Actuando como capa de traducción, aseguran que los sistemas antiguos puedan comunicarse con servicios más nuevos sin problemas. Los envolvedores centralizan tareas como seguridad, enrutamiento y análisis, simplificando operaciones.

Los envolvedores también optimizan el rendimiento al manejar autenticación, limitación de velocidad y traducción de protocolos. Pueden reducir cargas eliminando campos innecesarios o convirtiendo datos en formatos más eficientes, lo que conduce a un procesamiento más rápido.

"El middleware reduce la complejidad al traducir señales entre sistemas antiguos y servicios más nuevos, mejorando la interoperabilidad sin requerir revisiones completas del sistema." - Centro de Aprendizaje de Zuplo

Para sistemas con fuentes de datos dispersas, GraphQL puede servir como un envolvedor, permitiendo a los clientes solicitar solo los datos específicos que necesitan en una sola consulta. Desplegar envolvedores en el perímetro reduce aún más la latencia realizando operaciones como autenticación más cerca de los usuarios.

Ejemplos prácticos destacan el valor de los envolvedores. Un equipo que luchaba con una API móvil atrapada en 40 transacciones por segundo introdujo API en capas con procesamiento paralelo, caché, paginación y agrupación de conexiones. Estos cambios llevaron el sistema a 100 TPS. Los envolvedores simplifican la integración de sistemas heredados mientras los preparan para demandas futuras.

Modernización de API Heredadas Paso a Paso

Dar pasos incrementales para modernizar API heredadas puede reducir significativamente los riesgos de migración. Este enfoque es particularmente importante cuando consideras que el 83% de las migraciones de datos fallan o exceden sus presupuestos. Al actualizar sistemas gradualmente, puedes mantener la funcionalidad existente mientras introduces nuevos componentes que satisfacen las demandas actuales.

Migración a Arquitectura de Microservicios

Dividir una API monolítica en microservicios te da más control sin requerir una revisión completa. Una forma práctica de lograr esto es aplicando Patrón de la higuera estranguladora. Esto implica colocar una puerta de enlace de API—como Kong o AWS API Gateway—entre tus clientes y el sistema heredado. Desde allí, puedes reemplazar lentamente funciones específicas con microservicios. Comienza con componentes de bajo riesgo, enruta tráfico mínimo y expande según el rendimiento cumple las expectativas.

Shopify utilizó exitosamente este método en 2021 cuando refactorizó su modelo "Shop", un masivo "Objeto Dios" de 3,000 líneas. Lograron mantener los servicios ejecutándose para más de 1 millón de comerciantes mientras mejoraban su tiempo de canalización de CI en un 60%—de 45 minutos a 18 minutos—y redujeron los tiempos de implementación a aproximadamente 15 minutos.

Las organizaciones que adoptan esta estrategia a menudo reportan ahorros de costos de 20–35% después de la migración. Para garantizar consistencia durante la transición, puedes implementar escrituras simultáneas de datos tanto en las bases de datos antiguas como nuevas. Además, los disyuntores pueden salvaguardar el sistema deshabilitando temporalmente puntos finales cuando ocurren fallos, previniendo interrupciones generalizadas.

Uso de IA para Monitoreo de Rendimiento

Las herramientas de IA ofrecen una forma proactiva de monitorear el rendimiento analizando patrones de tráfico y detectando anomalías en tiempo real. Pueden rastrear problemas de latencia, sugerir correcciones e incluso predecir la demanda para una mejor asignación de recursos. El escalado predictivo asegura que los recursos estén listos cuando se necesiten, mientras que el enrutamiento de tráfico inteligente dirige a los usuarios a los puntos finales más rápidos durante el proceso de migración.

Para pruebas, la IA puede actualizar automáticamente scripts de pruebas rotos cuando el software cambia, reduciendo el tiempo de mantenimiento manual hasta un 70%. Herramientas como StormForge analizan datos de aplicaciones para recomendar la mejor asignación de recursos, lo que puede ayudar a reducir costos en la nube sin sacrificar el rendimiento.

Conexión con Plataformas Modernas

Modernizar sistemas heredados no siempre significa empezar de cero. Herramientas como DreamFactory pueden generar API REST a partir de bases de datos existentes en aproximadamente 5 minutos, transformando sistemas SOAP obsoletos en interfaces JSON REST. Esta capacidad, combinada con microservicios e información de IA, extiende la funcionalidad de API heredadas.

Ada, el constructor de IA de Adalo, te permite describir lo que deseas y genera tu app. Magic Start crea fundaciones de aplicaciones completas a partir de una descripción, mientras que Magic Add agrega funciones mediante lenguaje natural.

Una vez que estas API están operativas, generadores de aplicaciones impulsados por IA como Adalo pueden conectarse a ellas para construir aplicaciones móviles y web modernas. La función Colecciones Externas de Adalo permite extraer datos de microservicios y bases de datos heredadas, habilitando aplicaciones listas para producción en días en lugar de meses. El Generador de IA de la plataforma con Magic Start genera fundaciones completas de aplicaciones a partir de descripciones de texto—describe lo que quieres construir y crea automáticamente tu estructura de base de datos, pantallas y flujos de usuario.

Para equipos preocupados por la escalabilidad, la infraestructura modular de Adalo soporta aplicaciones con más de 1 millón de usuarios mensuales activos, procesando 20 millones+ de solicitudes diarias con 99%+ de tiempo de actividad. A diferencia de los envolvedores de aplicaciones que alcanzan límites de velocidad bajo carga, esta arquitectura construida específicamente mantiene el rendimiento a escala. A $36/mes sin límites en acciones, usuarios, registros o almacenamiento, ofrece precios predecibles sin los cargos basados en uso que hacen otras plataformas impredecibles.

El grupo Jochen Schweizer mydays adoptó un enfoque gradual para la modernización después de una fusión. Mantuvieron disponibilidad del 100% durante la transición, redujeron los tiempos de carga de página en un 37% e impulsaron significativamente las tasas de conversión. Sus esfuerzos les ganaron el premio "Cliente del Año" en Pimcore Inspire 2021.

Pruebas y Monitoreo del Rendimiento a lo Largo del Tiempo

Modernizar API heredadas no es una tarea de una sola vez—requiere pruebas y monitoreo consistentes para mantener el rendimiento. ¿El objetivo? Detectar y solucionar problemas antes de que afecten a los usuarios. La gestión del rendimiento es un proceso continuo.

Pruebas de Carga y Estrés

Diferentes métodos de prueba ayudan a descubrir debilidades específicas de API. Así es como funcionan:

- Prueba de línea base: Simula tráfico normal para establecer puntos de referencia de rendimiento.

- Pruebas de picos: Imita picos repentinos de tráfico, como una campaña de marketing viral, para ver cuán bien tu API maneja cargas inesperadas.

- Pruebas de estrés: Lleva tu API más allá de sus límites para identificar su punto de ruptura. Esto revela si tu sistema falla elegantemente con limitación de velocidad o colapsa completamente.

- Pruebas de resistencia: Aplica una carga moderada durante períodos extendidos para exponer fugas de recursos, como conexiones de base de datos no cerradas o problemas de memoria, que solo aparecen con el tiempo.

"Las pruebas de rendimiento de API se tratan de reducir el riesgo de fallo. La cantidad de esfuerzo que dediques a probar tu API debe ser proporcional al impacto que su fallo tendría en tu negocio." - Loadster

Observa patrones palo de hockey en resultados de pruebas—donde el rendimiento de repente se estabiliza, mientras que los tiempos de respuesta y errores se disparan dramáticamente. Herramientas como Bots de Protocolo de Loadster pueden automatizar solicitudes a nivel HTTP, eliminando la sobrecarga del navegador, mientras que EchoAPI desglosa solicitudes en etapas detalladas del ciclo de vida (p. ej., búsqueda DNS, protocolo de enlace SSL/TLS, tiempo hasta el primer byte). Estas perspectivas ayudan a identificar exactamente dónde ocurren los retrasos. Para resultados realistas, varía tus cargas de prueba con entradas diversas en lugar de golpear repetidamente la misma respuesta en caché.

Estas pruebas sientan las bases para el monitoreo continuo.

Monitoreo del Rendimiento en Tiempo Real

Mientras que las pruebas simulan posibles problemas, el monitoreo en tiempo real detecta problemas cuando suceden. Herramientas como Prometheus, New Relic, Dynatrace, y Datadog ofrecen rastreo distribuido, que rastrea solicitudes en todos los servicios, dándole visibilidad profunda en su sistema. Incluso un pequeño retraso—como 100 milisegundos—puede reducir las tasas de conversión en un 7%.

Enfóquese en tiempos de respuesta p95 y p99 (percentiles 95 y 99) en lugar de promedios. Estas métricas muestran cómo los usuarios experimentan su API durante tráfico alto o casos límite, no solo bajo condiciones ideales. Configure paneles con alertas para desviaciones, como cuando los tiempos de respuesta p95 superan 200 milisegundos. No olvide monitorear servicios de terceros. Sus problemas pueden impactar el rendimiento de su aplicación, incluso si sus sistemas internos funcionan bien.

Optimización Continua

Las pruebas y el monitoreo son solo el comienzo—la optimización continua asegura que su API siga mejorando. Por ejemplo, Xata redujo la latencia de la API en un 50% al usar la CDN de Cloudflare y la computación en el borde para procesar solicitudes más cerca de los usuarios. De manera similar, Netflix mejoró el rendimiento de la API en un 70% al implementar microservicios en el borde, reduciendo la distancia que los datos necesitaban recorrer entre clientes y servidores.

Integre pruebas de rendimiento en canales CI/CD (por ejemplo, Jenkins, GitLab, CircleCI) para validar el rendimiento sin ralentizar los despliegues. Use disyuntores para deshabilitar temporalmente endpoints problemáticos y evitar fallos en cascada. Finalmente, conecte mejoras técnicas con métricas comerciales—muestre cómo la latencia reducida aumenta las tasas de conversión o la retención de clientes. Esto mantiene a los interesados invertidos en mejoras de rendimiento.

Para equipos que construyen nuevos front-ends sobre APIs optimizadas, los constructores modernos de aplicaciones pueden acelerar significativamente el desarrollo. La función Magic Add de Adalo permite agregar pantallas y funcionalidades describiendo lo que desea en lenguaje simple, mientras que X-Ray destaca problemas de rendimiento antes de que afecten a los usuarios. Este enfoque asistido por IA significa que puede iterar rápidamente a medida que mejora el rendimiento de su API, sin esperar ciclos de desarrollo tradicionales.

Conclusión

El rendimiento de la API heredada es más que una preocupación técnica—es una prioridad empresarial crítica. Como señala acertadamente Nordic APIs:

El rendimiento de la API lo es todo. Es lo único que separa el éxito de su API de que sus usuarios abandonen su API en favor de algo más confiable y eficiente.

Cuando las APIs son lentas, los usuarios se van. Incluso retrasos menores pueden llevar a caídas abruptas en las tasas de conversión, mientras que los desarrolladores pierden tiempo valioso persiguiendo errores en lugar de crear nuevas funciones.

¿El lado positivo? No necesita una revisión completa para ver resultados. Una mezcla de victorias rápidas y mejoras estratégicas puede hacer el trabajo. Comience con arreglos simples como el almacenamiento en caché, que puede reducir los tiempos de respuesta en un 70–90%, o la compresión, que reduce el tamaño de las cargas útiles en un 60–80%. Estos cambios no solo proporcionan mejoras inmediatas sino que también sientan las bases para iniciativas más grandes como la transición a microservicios.

Piense en la optimización como un proceso paso a paso, no un esfuerzo único. Comience midiendo su rendimiento actual, luego enfóquese en cambios impactantes dentro de los primeros 30 días. Aborde cuellos de botella específicos durante los próximos tres meses, y planifique actualizaciones arquitectónicas más amplias dentro de seis meses o más. Este método minimiza riesgos mientras asegura la estabilidad del sistema durante toda la transición.

El costo de negligencia en el rendimiento va mucho más allá de APIs lentas. La pérdida de ingresos de carritos abandonados, los gastos crecientes de infraestructura y el daño a la reputación de su marca presentan un caso convincente para optimización proactiva. Las inversiones en mejora de rendimiento se amortiza significativamente a largo plazo.

Para mantenerse a la vanguardia, haga de la optimización un esfuerzo continuo. Integre pruebas en sus canales CI/CD y rastree métricas como tiempos de respuesta p95 y p99. Alinee mejoras técnicas con objetivos empresariales clave como aumentar las tasas de conversión y retener clientes. Este enfoque asegura que sus APIs no solo sigan el ritmo de las demandas de su negocio sino que también impulsen un crecimiento sostenido.

Publicaciones de Blog Relacionadas

- 5 Consejos para Reducir la Latencia de Consultas de Base de Datos

- Cómo las Aplicaciones Sin Código se Conectan a Sistemas Heredados

- Mejora del Tiempo de Respuesta de API con Bases de Datos Heredadas

- Integración Orientada por Eventos para Sistemas Heredados

Preguntas frecuentes

¿Por qué elegir Adalo sobre otras soluciones de construcción de aplicaciones?

Adalo es un constructor de aplicaciones impulsado por IA que crea verdaderas aplicaciones nativas de iOS y Android a partir de una única base de código. A diferencia de los envoltorios web, se compila a código nativo y se publica directamente tanto en la Apple App Store como en Google Play Store. A $36/mes sin límites en acciones, usuarios, registros o almacenamiento, ofrece precios predecibles sin los cargos basados en el uso que hacen impredecibles otras plataformas.

¿Cuál es la forma más rápida de construir y publicar una aplicación en la App Store?

El Generador de IA de Adalo con Magic Start genera fundamentos de aplicaciones completos a partir de descripciones de texto—describa lo que desea construir, y automáticamente crea su estructura de base de datos, pantallas y flujos de usuario. La plataforma maneja el complejo proceso de envío a App Store, para que pueda pasar de idea a aplicación publicada en días en lugar de meses.

¿Puedo construir fácilmente aplicaciones que se conecten a APIs heredadas sin codificación extensiva?

Sí. La función External Collections de Adalo le permite extraer datos de microservicios modernos y bases de datos heredadas. Puede crear aplicaciones listas para producción que interactúen con sistemas más antiguos mientras agrega capas modernas de almacenamiento en caché y optimización, todo sin escribir código.

¿Cuáles son las causas más comunes del rendimiento lento de la API heredada?

Las tres causas principales son la arquitectura obsoleta (sistemas monolíticos usando protocolos más antiguos como HTTP/1.1), la recuperación de datos ineficiente (consultas sin indexar y problemas N+1) y la falta de sistemas de almacenamiento en caché. Estos problemas crean cuellos de botella que ralentizan los tiempos de respuesta y frustran a los usuarios.

¿Cuánto puede mejorar el almacenamiento en caché los tiempos de respuesta de la API?

Implementar almacenamiento en caché puede reducir los tiempos de respuesta de la API en un 70% a 90% para respuestas almacenadas en caché. Una estrategia de almacenamiento en caché multinivel usando almacenamiento en caché de borde (Cloudflare), almacenamiento en caché a nivel de aplicación (Redis) y almacenamiento en caché del lado del cliente proporciona los mejores resultados al abordar diferentes partes del sistema.

¿Qué es el Patrón Strangler Fig para modernización de API?

El Patrón Strangler Fig es un enfoque de migración gradual donde coloca una puerta de enlace de API entre clientes y su sistema heredado, luego reemplaza lentamente funciones específicas con microservicios. Este método le permite modernizar gradualmente mientras mantiene disponibilidad del 100%, reduciendo el riesgo de migraciones fallidas.

¿Qué métricas debo monitorear para el rendimiento de la API?

Enfóquese en tiempos de respuesta p95 y p99 (percentiles 95 y 99) en lugar de promedios, ya que estos muestran cómo los usuarios experimentan su API durante tráfico alto o casos límite. También rastree Tiempo hasta el Primer Byte (TTFB), tasas de error y patrones de rendimiento para detectar problemas antes de que afecten a los usuarios.

¿Cuánto tiempo lleva modernizar un sistema de API heredada?

Un enfoque por fases funciona mejor: enfóquese en cambios impactantes como almacenamiento en caché dentro de los primeros 30 días, aborde cuellos de botella específicos durante los próximos tres meses, y planifique actualizaciones arquitectónicas más amplias dentro de seis meses o más. Esto minimiza riesgos mientras asegura la estabilidad del sistema durante toda la transición.

¿Cuál es la diferencia entre pruebas de carga y pruebas de estrés?

Las pruebas de carga simulan tráfico normal a esperado en su pico para establecer puntos de referencia de rendimiento. Las pruebas de estrés empujan su API más allá de sus límites para identificar puntos de ruptura y determinar si su sistema falla elegantemente con limitación de velocidad o se bloquea completamente bajo condiciones extremas.

¿Puedo escalar aplicaciones creadas en plataformas modernas para manejar millones de usuarios?

Sí. La infraestructura modular de Adalo soporta aplicaciones con más de 1 millón de usuarios activos mensuales, procesando 20 millones+ de solicitudes diarias con 99%+ de tiempo de actividad. A diferencia de los envoltorios de aplicaciones que alcanzan límites de velocidad bajo carga, esta arquitectura construida a propósito mantiene el rendimiento a escala.

Construye tu aplicación rápidamente con una de nuestras plantillas de aplicación prediseñadas

Comienza a construir sin código